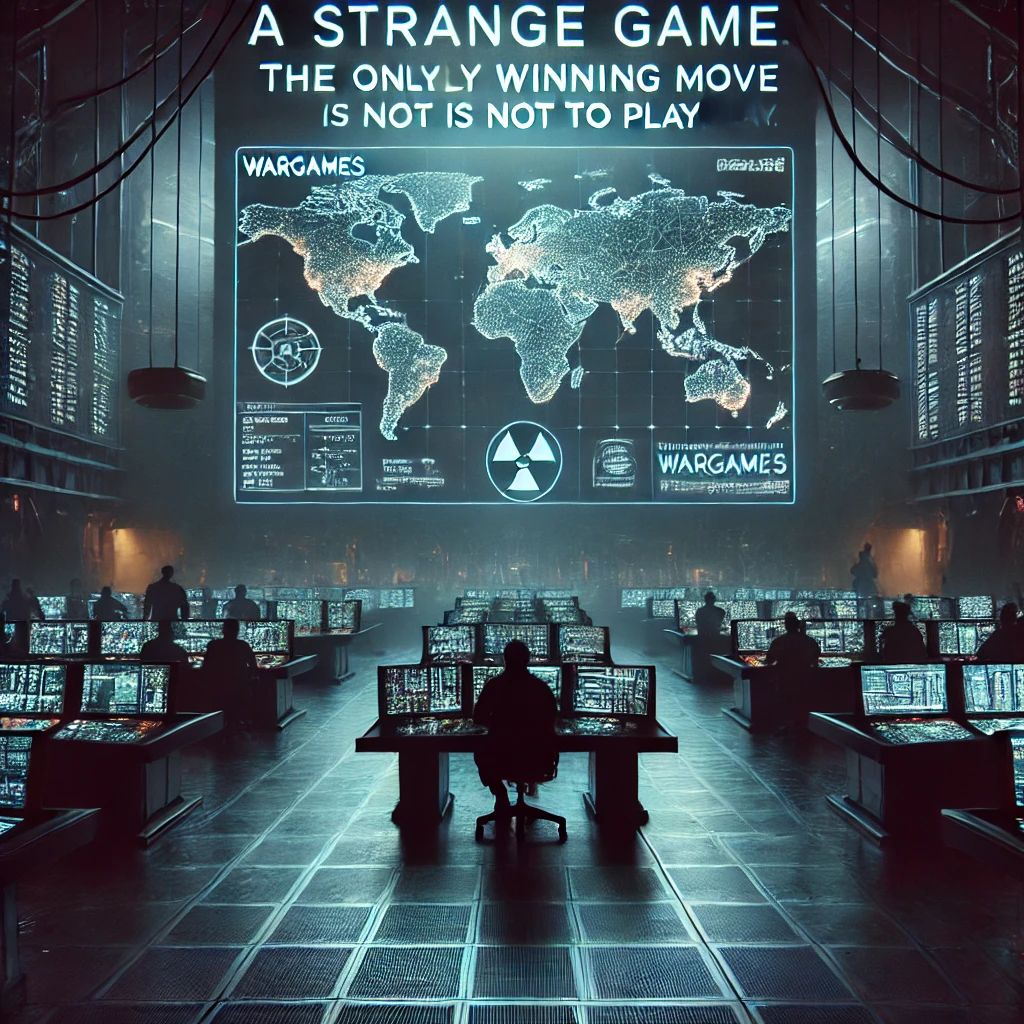

“Uno strano gioco. L’unica mossa vincente è non partecipare.”

Nel film WarGames di John Badham ricorderete la sequenza in cui, dopo aver fermato l’intelligenza artificiale del supercomputer WOPR dallo scatenare una guerra nucleare, il terminale del computer mostra la scritta “A STRANGE GAME. THE ONLY WINNING MOVE IS NOT TO PLAY“.

WOPR era un acronimo per War Operation Plan Response, un dispositivo in grado di simulare scenari di guerra nucleare. Una visione delle nuove tecnologie inquietante e – come va di moda scrivere in questi casi – profetica di ciò che viviamo in questi anni. Nello stesso film, del resto, il personaggio di David – l’hacker protagonista – aveva attivato il programma “Guerra globale termonucleare” accedendo ad un terminale di comando remoto, dal computer di casa, ritenendo si trattasse di un banale videogame. L’IA reagisce alla circostanza alzando i propri livelli di sicurezza, mentre si addestra con un numero sempre maggiore di dati e di potenziali casistiche belliche, senza fare differenza tra realtà (uno scenario di guerra effettivo) e simulazione (una battaglia simulata allo scopo di fornire informazioni ai militari).

La morale del film è nota, e vale la pena ribadirla: l’abuso tecnologico porta sempre alla rovina, ed esistono “giochi” a cui è opportuno non giocare: l’unica mossa vincente, a quel punto, è quella di non parteciparvi affatto. Un social network come X si addestra con i nostri dati personali e le nostre storie, non è interessato a fare differenze tra reale e virtuale, possiede un potere di suggestione ben superiore a WOPR e, cosa davvero grottesca, riesce a farlo abbassando il livello di protezione e sicurezza della piattaforma, al posto di alzarlo. Un parallelismo inquietante a cui, complici le esternazioni sempre più politicizzate e radicali di Musk, molti utenti hanno risposto fermando il proprio account, sospendendolo o cancellandolo del tutto.

Chiaro, bisogna saper dire di no. Lo facciamo ogni giorno, a pensarci, ed è una strategia di sopravvivenza nota: ci tiriamo indietro da relazioni che riteniamo poco adatte, anche se sembravano invitanti all’inizio. Cambiamo idea su una proposta di lavoro perchè precaria o mal pagata. Diciamo no a certe uscite tra amici perchè stanchi, stressati, poco focalizzati su noi stessi, poco a nostro agio – e per quanto la compagnia possa essere teoricamente desiderabile. Dire “no” è un valore aggiunto e sottovalutato, in genere. Ma il punto da cogliere è che in molti casi una discreta parte di chi sta abbandonando X è un organo di informazione, il che rischia di creare una situazione autoritaria o distopica in cui la totalità degli stessi sarà presente perchè a favore di Musk (pro-Trump / repubblicano, per estensione).

In certi giochi, nessuna mossa è quella vincente e lo sappiamo. E sui social come X, del resto, dovrebbe valere a maggior ragione: ci relazioniamo con una maggioranza di utenti che non vediamo mai dal vivo e, plausibilmente, non vedremo mai. Bisogna saper usare i social, e non darne per scontato l’uso. Abbiamo spesso a che fare con contatti sregolati, eufemismo per dire troll, in molti casi. Rispondiamo in modo incerto o perplesso a messaggi privati inattesi, invasivi e via dicendo. Leggiamo post inconcepibili o eccessivi perchè non possiamo accettarne la presenza e la convivenza. Sono in tanti a non aver accettato le regole del gioco di X, in effetti, e in tantissimi stanno progressivamente andando via dalla piattaforma (tra gli ultimi, Internazionale). Tanto per essere chiari, proverei a spiegare per esteso perchè – da utente tutt’altro che a favore di Trump – trovi l’abbandono in massa una mossa generalmente poco efficace alla causa, al netto di motivazioni personali di altro tipo.

Manifesto del non-abbandono

Alla base del tasso di abbandono di X c’è una linea di gestione della piattaforma che viene considerata troppo libertaria, al punto di minare le basi della democrazia, della reciproca convivenza e, in alcuni casi, sminuendo la portata di potenziali reati come hate speech, razzismo, cyberbullismo, apologia del fascismo e via dicendo. Fermo restando ovviamente che non tutti devono stare sui social e che qualcuno potrebbe semplicemente decidere di starne alla larga, ecco le principali motivazioni per cui trovo mediamente fuorviante uscire dalla piattaforma “per protesta”.

La protesta, a ben vedere, va fatta dall’interno, per il semplice fatto che è impossibile cambiare qualcosa da cui prendiamo le distanze.

Le regole possono cambiare

Anche se ad oggi (gennaio 2025) sembra improbabile un cambio di direzione nella gestione di X (che equivarrebbe ad un cambio di proprietario, da quello che capiamo), le cose potrebbero comunque cambiare nel medio-lungo periodo. Vedremo.

Soprattutto se persisteranno le polemiche sull’utilizzo, sulla ridotta usabilità della piattaforma, sul timore e sul disagio che provano molti utenti e sul fatto che gli inserzionisti potrebbero ritirare i finanziamenti se gli utenti non sono abbastanza vari per loro. Estremizzando, se tutti coloro che provano disagio andranno via da X, rimarranno primariamente troll a sguazzare liberamente tra loro, o saranno comunque una netta maggioranza rispetto agli utenti ordinari. E questo, naturalmente, realizza in modo preciso e macabro il “piano” iniziale voluto dal suo fautore. Chi esce per protesta, in altri termini, rischia semplicemente di spianare la strada alla normalizzazione dei contenuti violenti per cui è andato via. Come suggerisce Scully a Murder nel film di X-Files, “se me ne vado, vincono loro“. Senza contare che i troll, per loro stessa natura, sono spesso difficili da monetizzare per gli inserzionisti. E se perdi appeal commerciale, la piattaforma decade.

Non sei tu a stabilire colpe e meriti

Per quanto le piattaforme social siano ammantate di “democrazia” a corrente alternata (leggasi: solo quando conviene), in genere sono spazi privati, assimilabili più a centri commerciali che a piazze pubbliche. Nonostante parecchi analisi suggeriscano il contrario ed assimilino piattaforme come X a luoghi pubblici, l’ingresso in questo luogo pubblico richiede un’iscrizione, per quanto innocua possa sembrare – e per quanto si sia banalizzata l’idea di fornire i nostri dati per farlo. Quanti di noi entrerebbero serenamente in una piazza in cui non solo ti chiedono un documento all’ingresso, ma registrano almeno una parte dei nostri dati su un dispositivo non in nostro possesso? Sui social, dopati da campagne di marketing sempre più radicali e prive di scrupoli, il problema neanche ce lo poniamo. Men che meno su X dove, di fatto, aleggia una singolare e burrascosa idea di “libertà” dettata, più che altro, da egotismo e isteria di massa.

Sembrerebbe forse l’unico punto in favore della disiscrizione di massa, in effetti, e presenta un suo fascino oggettivo: il problema pero’ è che in questo caso bisognerebbe cancellarsi da qualsiasi piattaforma social. Senza voler difendere Musk in modo acritico, per intenderci, è quantomeno curioso come le figure di Zuckerberg o di Bezos (da tempo nell’occhio del ciclone per il loro avvicinamento alle politiche repubblicane di Trump, e tutt’altro che neutri politicamente) siano poco considerate dai media e dall’opinione pubblica, e difficilmente si metta in discussione l’opportunità etica di far parte dei loro mondi. Se il criterio per cui ci togliamo da X vale per Musk, uno dovrebbe valutare seriamente di cancellare il proprio account Facebook e, a quel punto, anche quello Amazon. Chi lo farebbe?

Cosa che farebbero in pochi, dato che i social network e gli ecommerce sono quasi un genere di prima necessità, e creano pure un effetto di attaccamento per cui, per semplificare, non ci cancelliamo per non perdere i contatti a cui magari, nel frattempo, siamo pure affezionati. Anche qui, sembra valere il mantra “if I quit, they win“: nessuno ci obbliga ad interagire con tutti, nessuno ci vieta di cercare altri spazi più flessibili.

La cosa essenziale è essere consapevoli che esiste il diritto di cancellare l’account, inalienabile, ma al tempo stesso è poco credibile come mezzo di protesta limitarsi a dire “non gioco più”. La vera protesta si fa dall’interno, come gli hacker della prima ora hanno sempre suggerito: trovando falle nel sistema, evidenziandole, mettendole a nudo nella loro debolezza o viltà. Sarà anche utopia e sì, certmente non tutti hanno gli strumenti per farlo, ma quegli hacker spesso diventati famosi non studiavano neanche nelle università e si limitavano ad aguzzare l’ingegno.

Del resto se queste figure mitologiche si fossero limitate a barricarsi dientro Linux e cancellare Windows e Mac OS dai loro PC, oggi non saremmo a conoscenza di molte delle falle informatiche che affliggono i sistemi Microsoft e Apple.

I social non usano dati esatti

Per quanto i sistemi informatici dispongano di molti dati – e per quanto la precisione possa essere elevata (anche solo per il gran numero di fonti da cui generalmente attingono), i dati non sono mai perfetti: approssimano, rendono l’idea in modo parziale, non per forza rappresentano ciò che dovrebbero. Questi errori sono subdoli e difficili / impossibili da rilevare, anche in casi banali: per intenderci, una persona potrebbe aver caricato nel proprio profilo una foto non recente, e potrebbe non essere realmente la “versione” di sè che racconta nel proprio storytelling digitale.

Del resto non siamo obbligati a dire la verità sui social, anche se tendiamo a dare per scontato che sia proprio il contrario e che tutti attorno a noi lo facciano. Questo vale a maggior ragione dopo l’esplosione creativa di content creator e guru di vario genere, che propongono contenuti commerciali dietro una maschera di “spontaneità” che è solo marketing, alla fine. Troviamo sempre più spesso prodotti miracolosi, servizi presunti innovativi, truffe di ogni genere, donne e uomini che sembrano perennemente carichi di sensualità o infinitamente disponibili. Sono falsi d’autore che collimano solo parzialmente con la realtà, che sembrano bastarci al punto di sostituirsi alla realtà, sulla falsariga di Baudrillard e della società dello spettacolo di Guy Debord. Internet non esprime la totalità del mondo: uno studio del 2024 afferma al contrario che gli LLM come ChatGPT e Gemini sono malamente addestrati su internet, e per questo tendono a replicare passivamente il punto di vista del “popolo del web” – populista, egemonico e non per forza maggioritario come potrebbe sembrare.

Abbandonare X perchè promuove contenuti falsi significa dimenticare questo aspetto, oltre a rischiare – alla lunga – di arrendersi alla falsa evidenza che i social siano la realtà, al posto di esserne una rappresentazione camuffata, ipocrita, grottesca e/o fuorviante. O magari una vera rivoluzione si potrà un giorno fare offline?

Non esiste il “paradiso perduto”

La migrazione in massa su BluSky di qualche mese fa è stata sostanziale, e (per inciso) anch’io vi ho partecipato (senza pero’ uscire da X, per i motivi che discuto qui). Ritenevo giusto stare su due piattaforme simili, anche in considerazione del fatto che molti contatti erano passati lì, e mi interessava continuare a seguirli. Questo porta a fare una considerazione ulteriore: abbandonare una piattaforma sgradita può portare a pensare che andare su un’altra sia salvifico o “balsamico” di per sè. Autori come Cory Doctorow raccontano da tempo per quale motivo non esiste la “piattaforma perfetta” mediante la teoria della enshittification: una catena di decisioni che porta ogni piattaforma social (quindi non solo X) dal sembrare un paradiso sulla terra, fino a un’overdose di contenuti commerciali e ad tossiche, tipicamente per finanziare la piattaforma in perdita finchè, dopo mille tribolazioni, finisce per collassare / perdere interesse.

Di fatto Musk sembra puntare a rendere X sempre più simile alla board 4chan, una board di utenti anonimi di grande successo, simile a Reddit – ma incentrata per larga parte su contenuti controversi, assenza totale di moderazione e contenuti con un tempo di vita mediamente breve. Finora, tutto sommato, ha funzionato, e gli abbandoni in massa rischiano ancora una volta di renderla esattamente ciò che il suo proprietario vorrebbe: un covo di troll sregolato e piatto, conformista e tragicamente (per loro) autoriferito.

Come se non bastasse, la scelta di mille piattaforme su cui distribuire gli utenti evoca sempre più la frammentazione del sociale, con miriadi di micro-board, distanziate e difficilmente interfacciabili tra loro, in cui ci saranno sempre più predicatori e sempre meno pensiero razionale e critico.

A meno che, ovviamente, non si segua il mantra “if I quit, they win“.

Non sei obbligato a leggere tutto

Questo è un punto che X non promuove abbastanza, a mio avviso.

Il fiume di contenuti che arrivano nelle nostre app è tale da mandarci in confusione, ma gli strumenti per evitarlo ci sono: basta cliccare sui tre puntini in alto al post che non ci interessa, e selezionare (neanche a dirlo!) “il post non mi interessa” – alla peggio si può ancora bloccare l’utente sgradito, oppure segnalarlo. Precisiamo: la segnalazione dell’era Musk di X è, per usare un eufemismo, quasi inutile: di circa una ventina segnalazioni che ho fatto, per capirci, solo una o due si sono concluse con il ban dell’utente. In fondo se scorgi qualcosa che ti scandalizza significa che vivi, in fondo, in una società libera.

Le leggi devono essere violate dalla società per progredire

Secondo il terzo punto del “manifesto” di Rickard Falkvinge – fondatore del Partito Pirata svedese – sulla società della sorveglianza c’è un aspetto importante da considerare: violare le regole, per quanto suoni sovversivo o criminale, è stato spesso necessario, nella storia, per far progredire la società. È capitato per le leggi dell’apartheid, con le discriminazioni di alcune minoranze e con molte leggi palesemente ingiuste che il progresso ha superato e sconfitto, anche a costo di pagarlo con il carcere o la morte dei suoi promotori.

Di contro, un social che faccia rispettare ogni regola è, come abbiamo già visto, irrealizzabile.

Al contrario, uno che non abbia alcuna regola sembra altrettanto utopistico, perchè alla lunga diventa ingestibile e perchè finirebbe per scaricare la colpa sui singoli utenti, al posto di assumersi responsabilità per eventuali mancanze (oltre che essere difficile da monetizzare e poco credibile agli occhi degli investitori).

Scrive Falkvinge:

Il progresso sociale impone la necessità assoluta di infrangere le leggi ingiuste, per mettere in discussione i propri valori, al fine di imparare dagli errori e andare avanti.

Tutto sta nel far apprendere gli errori “giusti” e non quelli errati alla piattaforma, notificandoli e sottolineandoli a dovere. Se al contrario nessuno segnala più che razzismo, cyberbullismo e fascismo sono errori che il sistema non dovrebbe accettare, saranno normalizzati, con conseguenze non prevedibili nel mondo reale.

Tanto vale, quindi, porsi la domanda in modo diverso: cosa posso fare di utile?